在 zi2zi-pytorch 的版本, 有分別把 source font 與 target font 把空白區域移掉後, 再進行訓練, 理論上是更有效率沒錯, 排除掉空白區域, 在相同的解析度下, 是可以取得更多細節, 實際上以為會遇到縮放的問題, 實際測雖然訓練的資料是放大的, 在推論時輸入的資料是縮小的, 實際上推論結果是正確的大小.

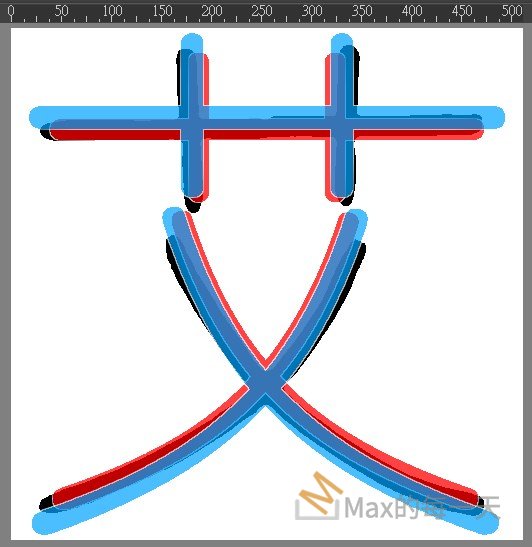

以這個例子來說, 藍色是被放大的訓練資料, 紅色是實際要學習的 target font. 黑色是推論結果.

排除掉空白區域

- 優點: 可以處理部份文字會在框線外的問題,

- 缺點: 是會失去空間資訊, 也可能遇到 source font 與 target font 比例互相沖突的字, 但機率非常非常的低, 例如: 作者心血來潮, 把某一個特徵(規則)之外讓字填滿可視區域, 但在思源黑體這個字, 只占畫面中宮的一小部份.